FUNKTIONSWEISE |

|

GRUNDLAGEN

|

| REFERENZEN |

|

|

| English |

|

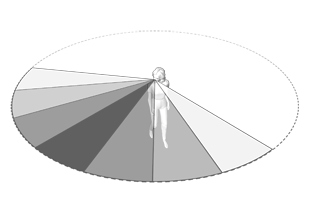

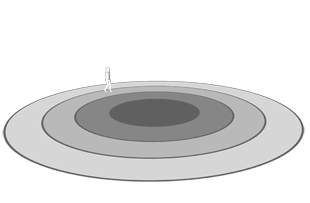

Technisch basiert das System auf einer tragbaren Computerausrüstung mit GPS und einem Intertialsystem. Ein „Head Mounted Display“, eine Art Brille mit Kameras, Mikrofon und Kopfhörern, spielt je nach Standort und Blickrichtung Informationen ins Wahrnehmungsfeld der Spazierenden ein. Die aufgenommenen Bilder und Geräusche werden in Echtzeit bearbeitet und mit audiovisuellen Elementen ergänzt. Auf ihrem Gang durch das inszenierte Terrain rufen die Spazierenden Medienelemente wie Fotos, Videos oder Tonaufnahmen ab. Sie können die Inszenierung durch die Veränderung ihrer Position, Blickrichtung, durch verschiedene Gehgeschwindigkeiten oder durch ein handgehaltenes Gerät beeinflussen. Die Koordinaten der virtuellen 3D-Welt werden mit denen der realen Welt aufgrund von Position (x, y, z) und Blickrichtung (u, v, w) des Nutzers geeicht, was sechs Freiheitsgrade der interaktiven Partizipation schafft. Dadurch können narrative Elemente wie 3D-Objekte, Bild- oder Klangsequenzen räumlich positioniert und präzise im Kontext der realen Landschaft verankert werden.

|

![]()